Nuestro cerebro aprende modificando las conexiones entre neuronas, llamadas sinapsis. Pero un nuevo estudio publicado en 2025 en Science por investigadores de la Universidad de California en San Diego revela que las reglas que rigen estos cambios sinápticos no son iguales en todas partes de una neurona. Usando tecnologías avanzadas de imagen, los científicos observaron en tiempo real cómo las sinapsis cambian durante el aprendizaje motor en ratones.

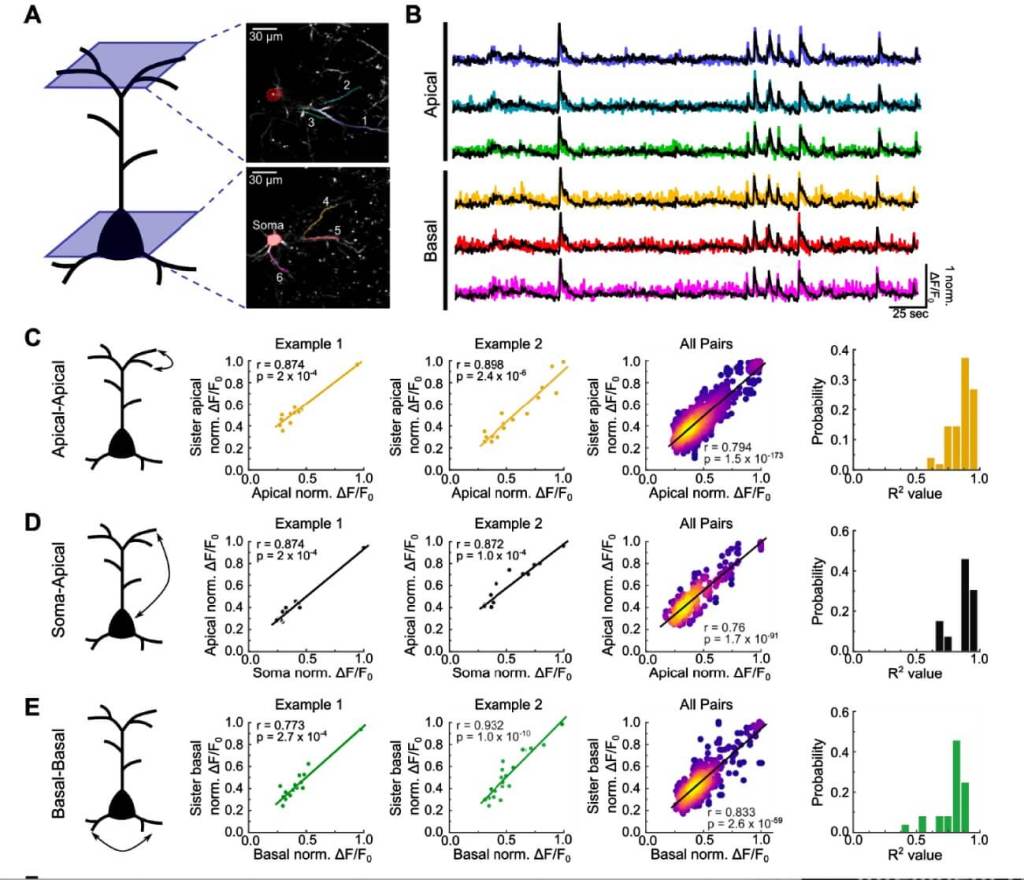

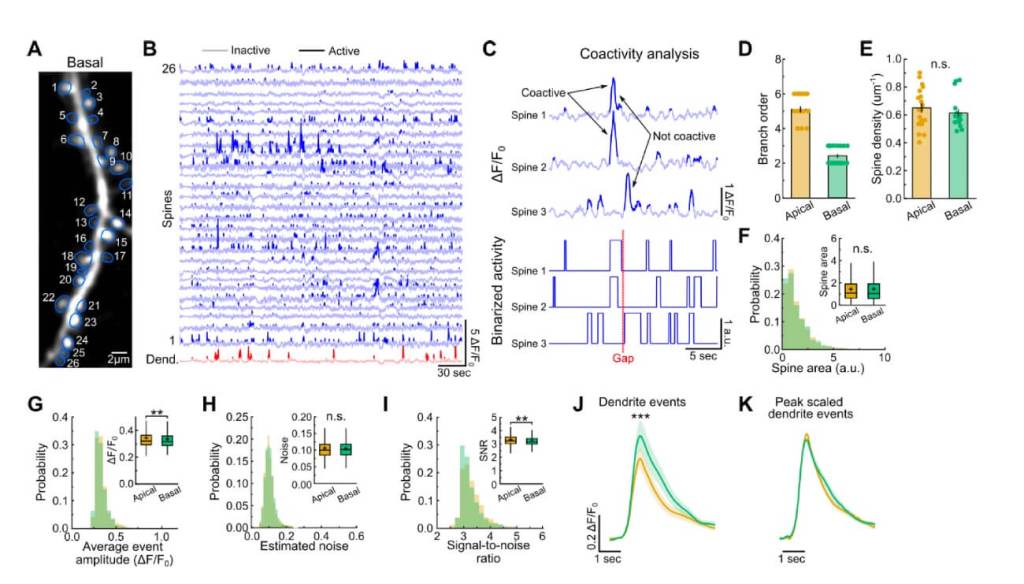

El equipo descubrió que las sinapsis ubicadas en las dendritas apicales y basales de las neuronas piramidales de la corteza motora operan bajo mecanismos de plasticidad completamente distintos.

Las dendritas apicales fortalecen sinapsis cuando se activan junto a otras sinapsis vecinas, mientras que en las dendritas basales el fortalecimiento depende de que la neurona haya disparado un potencial de acción.

Este hallazgo cambia la forma en que entendemos el aprendizaje a nivel celular. Hasta ahora se asumía que cada neurona seguía una única regla general de aprendizaje, pero esta investigación demuestra que dentro de una misma célula pueden coexistir reglas especializadas para distintas funciones cognitivas.

“Cuando la gente habla de plasticidad sináptica, generalmente se considera uniforme dentro del cerebro”, dijo William Wright, autor del estudio y académico postdoctoral de la Escuela de Ciencias Biológicas de la Universidad de California en San Diego.

“Nuestra investigación proporciona una comprensión más clara de cómo se están modificando las sinapsis durante el aprendizaje, con implicaciones potencialmente importantes para la salud, ya que muchas enfermedades en el cerebro implican algún tipo de disfunción sináptica”.

Dos reglas distintas, dos funciones complementarias

Al analizar el comportamiento de las sinapsis durante tareas de aprendizaje motor, los científicos comprobaron que las dendritas apicales crean “clústeres” funcionales de sinapsis activas, lo que podría facilitar una integración no lineal de la información. Este tipo de integración permite al cerebro combinar múltiples señales y generar respuestas más complejas.

Por su parte, las sinapsis en las dendritas basales parecen actuar como un sistema de refuerzo más clásico, donde se premia la coincidencia entre la entrada sináptica y la salida neuronal. Este tipo de plasticidad, conocida como hebbiana, favorece la formación de patrones estables y fiables, lo que podría estar vinculado a la memoria y al reconocimiento de patrones.

En conjunto, estos dos tipos de plasticidad permiten que una misma neurona desempeñe tareas de cálculo más versátiles. Mientras una parte integra información de forma flexible, otra consolida aprendizajes que ya han demostrado ser útiles. Este hallazgo podría tener implicancias importantes para entender cómo almacenamos conocimientos y habilidades en el cerebro.

Un modelo más preciso para entender cómo aprendemos

La investigación aborda un viejo problema en neurociencia conocido como “problema de la asignación de crédito”. Las sinapsis solo tienen información local sobre su actividad, pero de alguna manera logran contribuir al aprendizaje global del cerebro.

Este estudio sugiere que la solución está en la especialización de reglas dentro de la neurona, lo que permite que distintas zonas cumplan funciones complementarias.

Utilizando tecnologías de imagen de dos fotones, los investigadores pudieron observar cómo sinapsis individuales se fortalecen o debilitan en función de su localización y actividad durante tareas de aprendizaje.

En experimentos donde se bloqueó la actividad eléctrica de las neuronas, la plasticidad en las dendritas basales desapareció, pero la de las apicales se mantuvo, confirmando su independencia del disparo neuronal.

Esto implica que cada neurona no es una unidad de procesamiento uniforme, sino un conjunto de módulos con reglas propias, capaces de adaptarse a diferentes demandas cognitivas. La comprensión de este principio podría revolucionar nuestra forma de abordar el estudio del cerebro.

Resolver el rompecabezas del aprendizaje: el reparto de crédito en las neuronas

Una de las grandes preguntas en neurociencia es cómo el cerebro logra identificar cuáles de las miles de conexiones sinápticas deben fortalecerse después de una experiencia de aprendizaje. A pesar de esta limitación, el cerebro ajusta sus conexiones con precisión, lo que sugiere la existencia de mecanismos internos que permiten a las neuronas procesar información de forma altamente especializada.

El nuevo estudio ofrece una posible solución a este misterio: las neuronas aplican reglas distintas de plasticidad sináptica dependiendo de la región de la dendrita donde ocurre la señal. En las dendritas basales, el fortalecimiento sináptico depende de la coincidencia con potenciales de acción de la neurona, mientras que en las apicales se basa en la sincronía local con otras sinapsis vecinas.

Esta segmentación funcional dentro de una misma célula permite que múltiples “decisiones de aprendizaje” ocurran simultáneamente, cada una con su propio criterio.

Esta estrategia compartimental permite que una sola neurona evalúe de manera independiente distintas fuentes de información, resolviendo así, en parte, el problema del reparto de crédito.

En lugar de depender de una señal centralizada, cada compartimento dendrítico puede tomar decisiones locales sobre qué sinapsis reforzar, según su contexto y función específica. Este hallazgo redefine cómo entendemos el procesamiento paralelo en el cerebro y plantea nuevas preguntas sobre su eficiencia evolutiva.

¿Y si la IA aprendiera como una neurona real? Nuevas pistas desde la biología

Las redes neuronales artificiales, base de muchas tecnologías de inteligencia artificial, se inspiran en el funcionamiento del cerebro humano. Sin embargo, suelen aplicar una única regla de aprendizaje —como el famoso algoritmo de retropropagación— a toda la red.

Este enfoque ha sido eficaz en muchos contextos, pero no refleja la complejidad y diversidad de estrategias que usan las neuronas biológicas para modificar sus conexiones durante el aprendizaje.

El estudio revela que una neurona real puede operar con distintas reglas de plasticidad sináptica en diferentes compartimentos. Las dendritas basales utilizan mecanismos Hebbianos clásicos, mientras que las apicales se guían por la coincidencia con sinapsis cercanas.

Este comportamiento sugiere que cada parte de una neurona puede especializarse en un tipo de cómputo, aplicando su propia regla de aprendizaje, lo que otorga una gran versatilidad a la célula.

Este concepto abre la puerta al diseño de sistemas de inteligencia artificial más sofisticados y adaptativos. En lugar de aplicar una sola regla a todos los nodos, podrían programarse unidades con “compartimentos” que aprendan según distintas condiciones, imitando la estructura de las dendritas neuronales. Una IA que aprendiera como una neurona real no solo sería más precisa, sino también más resiliente ante entornos complejos y cambiantes.

Implicancias futuras en salud cerebral e inteligencia artificial

Entender la diversidad de reglas sinápticas tiene un gran potencial terapéutico. Muchos trastornos neurológicos y psiquiátricos están vinculados con alteraciones en la plasticidad sináptica. Conocer cuáles reglas fallan y en qué parte de la neurona podría ayudar a desarrollar tratamientos más precisos y personalizados.

“Este trabajo está sentando una base potencial para tratar de entender cómo funciona normalmente el cerebro para permitirnos entender mejor lo que está mal en estas diferentes enfermedades”, dijo Wright.

Los autores mencionan condiciones como la enfermedad de Alzheimer o el estrés postraumático como ámbitos donde este conocimiento podría tener aplicaciones clínicas.

Además, la investigación también podría inspirar nuevos modelos para redes neuronales artificiales, ya que actualmente la mayoría de estas redes aplican una única regla de aprendizaje para toda la estructura.

Incorporar distintos tipos de plasticidad en una misma unidad artificial podría mejorar la capacidad de estas redes para resolver problemas complejos, como reconocimiento de patrones, lenguaje natural o toma de decisiones. En este sentido, el cerebro sigue siendo la fuente de inspiración más poderosa para el desarrollo de inteligencia artificial avanzada.

Referencias

- Wright, William J., Nathan G. Hedrick, and Takaki Komiyama. Distinct synaptic plasticity rules operate across dendritic compartments in vivo during learning. Science. (2025). doi: 10.1126/science.ads4706

Cortesía de Muy Interesante

Dejanos un comentario: